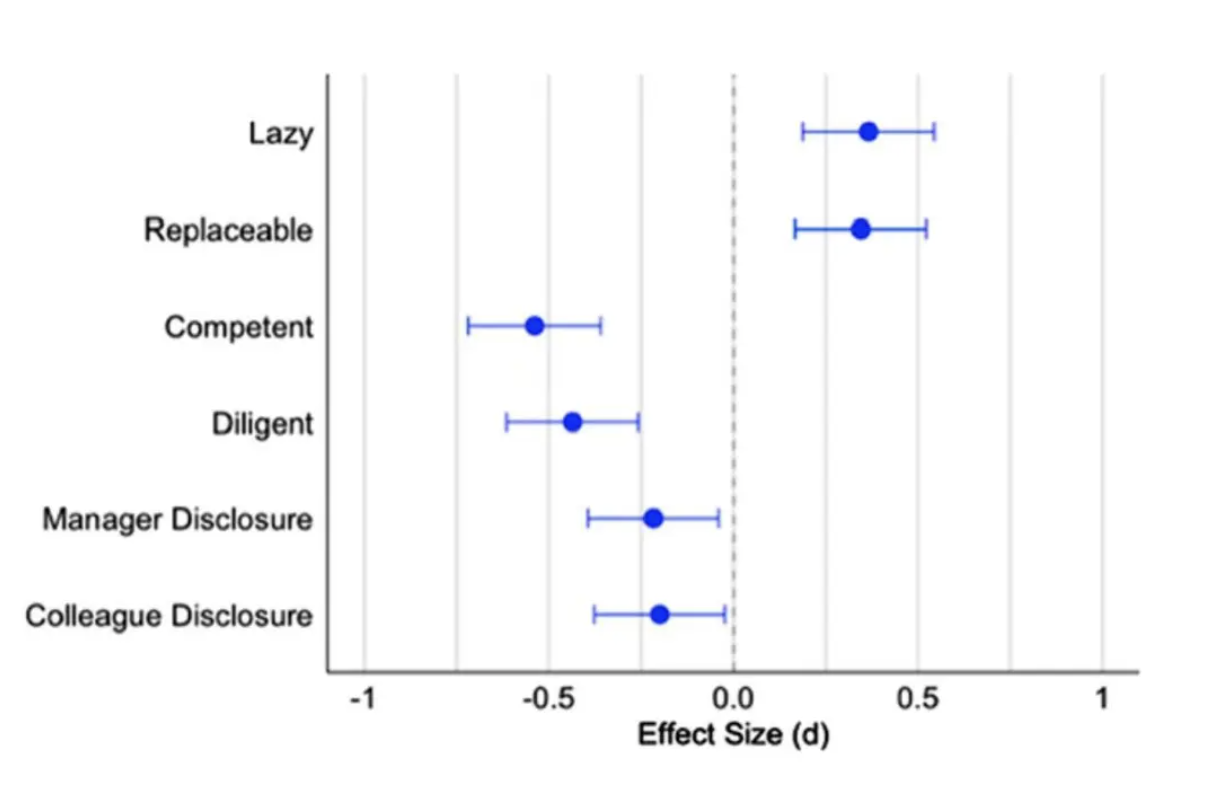

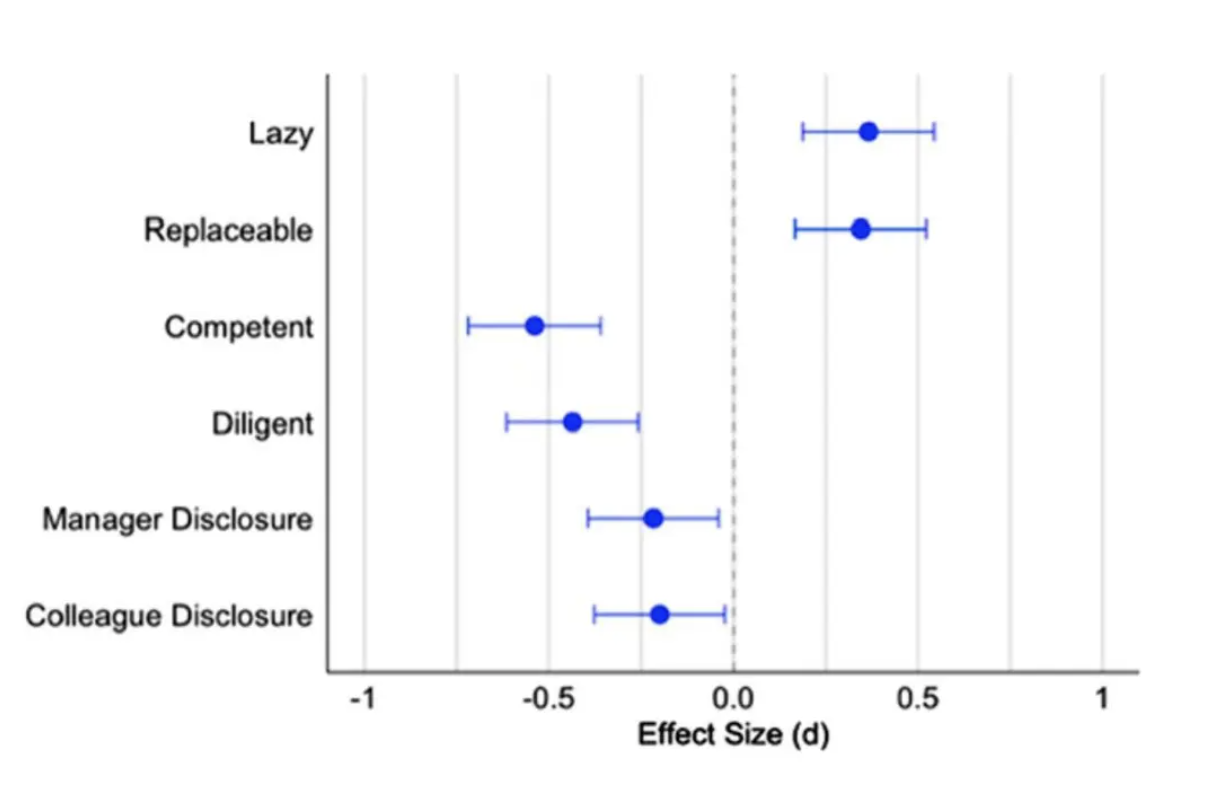

根据杜克大学的一项新研究,人工智能的使用可能是双叶片。尽管生成的AI工具可以提高某些人的生产力,但它们也可能会意外损害您的专业声誉。本文指出:周四,美国国家科学院(PNAS)会议录(PNAS)发表了一项研究,该研究表明,使用人工智能工具(例如Chatgpt,Claude和Gemini Work)的员工将对同事和经理评估他们的能力和动机。研究人员Jessica A.Reif,Richard P. Larrick和Jack B. Soll的杜克大学福卡(Fuka fuka)商学院的研究人员。 “杜克小组对4,400多名参与者进行了四项实验,以研究AI工具用户的期望和实际评论。组。智能。” “测试广泛的刺激使我们可以测试如果年龄,性别或占领目标会影响访问AI进行此测试的效果,“由那些撰写论文的人写。这表明AI使用的社会污名不限于使用特定人群。结果似乎是一种普遍现象。这些担忧是合理的。Gree,那些从AI提供帮助的人也从非资源的非助人人士那里获得了类似的帮助,他们的懒惰,能力较差,热情不足,独立和自信心。图2论文“使用人工智能的社会分析的惩罚证据”研究人员发现,这种偏见会影响实际的业务决策。在招聘模拟实验中,不使用AI本身的管理人员不太愿意使用AI。它表明审稿人在使用人工智能方面的经历会极大地影响其判断。在学习时,频繁的AI用户不太可能认为使用AI的候选人很懒惰。杜克复杂的AI情况还指出,历史上其他新技术也引起了类似的污名化问题。从柏拉图的质疑写作是否可以削弱智慧,到有关使用教育计算器的现代辩论,长期以来一直担心避免劳动工具可能反映用户的功能不足。 Reif及其同事认为,这种社会影响可能是AI在工作场所采用的隐藏障碍。尽管组织促进了人工智能的实施,但由于担心如何看待他们,可能会受到限制。这个困境似乎出现了。去年八月,有报道说,活跃的每周Chatgpt是2亿用户时,我们提到沃顿教授Esson Molik(经常研究人工智能)称呼使用人工智能但不告诉老板“秘密机器人”的人。像许多禁止AI产出的公司一样,据称许多员工都在秘密使用AI。如果这还不够复杂,我们先前报告的另一项研究为AI的工作场所问题增加了不同的维度。芝加哥大学和哥本哈根大学的经济学家发现,尽管有64%至90%的员工报告了AI工具的节省,但这些好处有时是是技术创建的新任务。研究表明,AI工具实际上为8.4%的员工创造了额外的工作,包括负责评估AI的输出质量或在学生作业中发现AI使用的非用户。因此,尽管使用AI来完成某些任务可以节省时间,但员工可以为自己或他人创造其他工作。实际上,世界经济论坛的《 2025年就业前景报告》已经教导说,人工智能可以在全球范围内创造1.7亿个新就业机会,同时删除9200万个就业机会,到2030年,净净额增加了7,800万。

根据杜克大学的一项新研究,人工智能的使用可能是双叶片。尽管生成的AI工具可以提高某些人的生产力,但它们也可能会意外损害您的专业声誉。本文指出:周四,美国国家科学院(PNAS)会议录(PNAS)发表了一项研究,该研究表明,使用人工智能工具(例如Chatgpt,Claude和Gemini Work)的员工将对同事和经理评估他们的能力和动机。研究人员Jessica A.Reif,Richard P. Larrick和Jack B. Soll的杜克大学福卡(Fuka fuka)商学院的研究人员。 “杜克小组对4,400多名参与者进行了四项实验,以研究AI工具用户的期望和实际评论。组。智能。” “测试广泛的刺激使我们可以测试如果年龄,性别或占领目标会影响访问AI进行此测试的效果,“由那些撰写论文的人写。这表明AI使用的社会污名不限于使用特定人群。结果似乎是一种普遍现象。这些担忧是合理的。Gree,那些从AI提供帮助的人也从非资源的非助人人士那里获得了类似的帮助,他们的懒惰,能力较差,热情不足,独立和自信心。图2论文“使用人工智能的社会分析的惩罚证据”研究人员发现,这种偏见会影响实际的业务决策。在招聘模拟实验中,不使用AI本身的管理人员不太愿意使用AI。它表明审稿人在使用人工智能方面的经历会极大地影响其判断。在学习时,频繁的AI用户不太可能认为使用AI的候选人很懒惰。杜克复杂的AI情况还指出,历史上其他新技术也引起了类似的污名化问题。从柏拉图的质疑写作是否可以削弱智慧,到有关使用教育计算器的现代辩论,长期以来一直担心避免劳动工具可能反映用户的功能不足。 Reif及其同事认为,这种社会影响可能是AI在工作场所采用的隐藏障碍。尽管组织促进了人工智能的实施,但由于担心如何看待他们,可能会受到限制。这个困境似乎出现了。去年八月,有报道说,活跃的每周Chatgpt是2亿用户时,我们提到沃顿教授Esson Molik(经常研究人工智能)称呼使用人工智能但不告诉老板“秘密机器人”的人。像许多禁止AI产出的公司一样,据称许多员工都在秘密使用AI。如果这还不够复杂,我们先前报告的另一项研究为AI的工作场所问题增加了不同的维度。芝加哥大学和哥本哈根大学的经济学家发现,尽管有64%至90%的员工报告了AI工具的节省,但这些好处有时是是技术创建的新任务。研究表明,AI工具实际上为8.4%的员工创造了额外的工作,包括负责评估AI的输出质量或在学生作业中发现AI使用的非用户。因此,尽管使用AI来完成某些任务可以节省时间,但员工可以为自己或他人创造其他工作。实际上,世界经济论坛的《 2025年就业前景报告》已经教导说,人工智能可以在全球范围内创造1.7亿个新就业机会,同时删除9200万个就业机会,到2030年,净净额增加了7,800万。

研究表明,AI使用将对专业声誉产生负面影响

根据杜克大学的一项新研究,人工智能的使用可能是双叶片。尽管生成的AI工具可以提高某些人的生产力,但它们也可能会意外损害您的专业声誉。本文指出:周四,美国国家科学院(PNAS)会议录(PNAS)发表了一项研究,该研究表明,使用人工智能工具(例如Chatgpt,Claude和Gemini Work)的员工将对同事和经理评估他们的能力和动机。研究人员Jessica A.Reif,Richard P. Larrick和Jack B. Soll的杜克大学福卡(Fuka fuka)商学院的研究人员。 “杜克小组对4,400多名参与者进行了四项实验,以研究AI工具用户的期望和实际评论。组。智能。” “测试广泛的刺激使我们可以测试如果年龄,性别或占领目标会影响访问AI进行此测试的效果,“由那些撰写论文的人写。这表明AI使用的社会污名不限于使用特定人群。结果似乎是一种普遍现象。这些担忧是合理的。Gree,那些从AI提供帮助的人也从非资源的非助人人士那里获得了类似的帮助,他们的懒惰,能力较差,热情不足,独立和自信心。图2论文“使用人工智能的社会分析的惩罚证据”研究人员发现,这种偏见会影响实际的业务决策。在招聘模拟实验中,不使用AI本身的管理人员不太愿意使用AI。它表明审稿人在使用人工智能方面的经历会极大地影响其判断。在学习时,频繁的AI用户不太可能认为使用AI的候选人很懒惰。杜克复杂的AI情况还指出,历史上其他新技术也引起了类似的污名化问题。从柏拉图的质疑写作是否可以削弱智慧,到有关使用教育计算器的现代辩论,长期以来一直担心避免劳动工具可能反映用户的功能不足。 Reif及其同事认为,这种社会影响可能是AI在工作场所采用的隐藏障碍。尽管组织促进了人工智能的实施,但由于担心如何看待他们,可能会受到限制。这个困境似乎出现了。去年八月,有报道说,活跃的每周Chatgpt是2亿用户时,我们提到沃顿教授Esson Molik(经常研究人工智能)称呼使用人工智能但不告诉老板“秘密机器人”的人。像许多禁止AI产出的公司一样,据称许多员工都在秘密使用AI。如果这还不够复杂,我们先前报告的另一项研究为AI的工作场所问题增加了不同的维度。芝加哥大学和哥本哈根大学的经济学家发现,尽管有64%至90%的员工报告了AI工具的节省,但这些好处有时是是技术创建的新任务。研究表明,AI工具实际上为8.4%的员工创造了额外的工作,包括负责评估AI的输出质量或在学生作业中发现AI使用的非用户。因此,尽管使用AI来完成某些任务可以节省时间,但员工可以为自己或他人创造其他工作。实际上,世界经济论坛的《 2025年就业前景报告》已经教导说,人工智能可以在全球范围内创造1.7亿个新就业机会,同时删除9200万个就业机会,到2030年,净净额增加了7,800万。

根据杜克大学的一项新研究,人工智能的使用可能是双叶片。尽管生成的AI工具可以提高某些人的生产力,但它们也可能会意外损害您的专业声誉。本文指出:周四,美国国家科学院(PNAS)会议录(PNAS)发表了一项研究,该研究表明,使用人工智能工具(例如Chatgpt,Claude和Gemini Work)的员工将对同事和经理评估他们的能力和动机。研究人员Jessica A.Reif,Richard P. Larrick和Jack B. Soll的杜克大学福卡(Fuka fuka)商学院的研究人员。 “杜克小组对4,400多名参与者进行了四项实验,以研究AI工具用户的期望和实际评论。组。智能。” “测试广泛的刺激使我们可以测试如果年龄,性别或占领目标会影响访问AI进行此测试的效果,“由那些撰写论文的人写。这表明AI使用的社会污名不限于使用特定人群。结果似乎是一种普遍现象。这些担忧是合理的。Gree,那些从AI提供帮助的人也从非资源的非助人人士那里获得了类似的帮助,他们的懒惰,能力较差,热情不足,独立和自信心。图2论文“使用人工智能的社会分析的惩罚证据”研究人员发现,这种偏见会影响实际的业务决策。在招聘模拟实验中,不使用AI本身的管理人员不太愿意使用AI。它表明审稿人在使用人工智能方面的经历会极大地影响其判断。在学习时,频繁的AI用户不太可能认为使用AI的候选人很懒惰。杜克复杂的AI情况还指出,历史上其他新技术也引起了类似的污名化问题。从柏拉图的质疑写作是否可以削弱智慧,到有关使用教育计算器的现代辩论,长期以来一直担心避免劳动工具可能反映用户的功能不足。 Reif及其同事认为,这种社会影响可能是AI在工作场所采用的隐藏障碍。尽管组织促进了人工智能的实施,但由于担心如何看待他们,可能会受到限制。这个困境似乎出现了。去年八月,有报道说,活跃的每周Chatgpt是2亿用户时,我们提到沃顿教授Esson Molik(经常研究人工智能)称呼使用人工智能但不告诉老板“秘密机器人”的人。像许多禁止AI产出的公司一样,据称许多员工都在秘密使用AI。如果这还不够复杂,我们先前报告的另一项研究为AI的工作场所问题增加了不同的维度。芝加哥大学和哥本哈根大学的经济学家发现,尽管有64%至90%的员工报告了AI工具的节省,但这些好处有时是是技术创建的新任务。研究表明,AI工具实际上为8.4%的员工创造了额外的工作,包括负责评估AI的输出质量或在学生作业中发现AI使用的非用户。因此,尽管使用AI来完成某些任务可以节省时间,但员工可以为自己或他人创造其他工作。实际上,世界经济论坛的《 2025年就业前景报告》已经教导说,人工智能可以在全球范围内创造1.7亿个新就业机会,同时删除9200万个就业机会,到2030年,净净额增加了7,800万。